Suni Zekânın Gizlilik Sorununu Çözebilecek Teknikler

Pek oldukça firmanın başını ağrıtan ve yargılanmasına yol açan, suni zekânın doğasında bulunan gizlilik sorununu çözebilecek teknikler neler? Gelin, bu yazımızda bu teknikleri hep birlikte inceleyelim.

Çağımızın yükselen teknolojisi suni zekâ, sivil planlamadan sıhhat hizmetlerine ve siber güvenliğe kadar tüm endüstrilerde bir dönüşümü vadediyor. Lakin gizlilik, bilhassa uyum ve düzenleme söz mevzusu olduğunda sektörde çözülemeyen bir güçlük olmaya devam ediyor. Hatta pek oldukça şirket, kişisel verilerin sızdırılması sebebiyle gündeme geliyor.

Bu aşamada Apple ve Google benzer biçimde pek oldukça devasa firmanın bu mevzudan muzdarip bulunduğunu söylemek mümkün. Hatırlarsanız Apple, Siri kayıtlarının dinlenmesi skandalıyla bir süre gündemden düşmemişti. Nisan ayında Bloomberg, bilişim devi Amazon’un Alexa destekli cihazlardan binlerce saatlik ses kayıtlarını dinlemek için taşeron işçiler kullandığını ortaya çıkarmıştı.

Son dönemlerde bunun benzer biçimde binlerce değişik olayın yaşandığını ve pek oldukça dev firmanın bu vakalarla gündeme geldiğini söyleyebiliriz. Evet, yasalar gizliliği korumak için çalışıyor sadece kafi değil. Peki suni zekanın gizlilik sorununu hangi teknikler çözebilir? Gelin, bunlara birazcık daha yakından bakalım.

Suni sinir ağları ve güvenlik açıkları:

İnsan beyni ve sinir sisteminden esinlenerek oluşturulmuş bu modelde, ilk katman girişi son katman ise çıkışı temsil eder. Ortada bulunan katmanlar ise gizli saklı katmanlardır ve her katmanda belirli sayıda nöron (neuron/sinir hücresi) bulunur. Bir çok suni zekâ sisteminin merkezinde bulunan sinir ağları, öteki nöronlara sinyal ileten katmanlarda düzenlenmiş fonksiyonlardan oluşur.

Bu sinyaller, katmandan katmana geçer ve her bağlantının sinaptik kuvvetini ayarlayarak ağı yavaşça ayarlar. Sinir ağları ham görüntüleri, videoları sesi ve metni almaz. Daha ziyade alıştırma yapılarından örnekler; tek sayılar, vektörler ve matrisler benzer biçimde cebirsel olarak oldukça boyutlu dizilere dönüştürülür. Tüm bu tarz şeyleri kapsayan dördüncü bir varlık türüyse geçerli doğrusal dönüşümlerin açıklamalarına eklenmiş olur.

Bu dönüşümlere karşın potansiyel olarak duyarlı detayları, sinir ağının çıktılarından ayırt etmek bir çok vakit mümkündür. Ek olarak veri kümelerinin kendileri de savunmasızdır şundan dolayı genel anlamda gizlenmezler ve veri ihlallerine karşı savunmasız olan merkezi depolarda depolanırlar.

Şimdiye kadar en yaygın tersine mühendislik makine öğrenimi olarak malum “membership inference attack” ve bu teknikle bir saldırgan, hedef modelin eğitildiği yapıya ilişik olup olmadığını belirler. Anlaşılacağı suretiyle duyarlı detayları bir veri kümesinden kaldırmak, tekrardan çıkarılamayacağı anlamına gelmez şundan dolayı suni zekâ örnekleri tekrardan oluşturmada son aşama başarılıdır.

Bir çalışmada Wisconsin Üniversitesi’nden araştırmacılar, tıbbi dozajı kestirmek suretiyle eğitilmiş bir makine öğrenme modelinden hastaların genomik bilgilerini aldılar. Bir öteki çalışmada ise Carneige Mellon ve Wisconsin-Madison Üniversitesi araştırmacıları, yüz tanıma yapmak için eğitilmiş bir modelden belirli kafa çekimi görüntülerini tekrardan oluşturmayı başardılar.

Daha karmaşık bir veri çıkarma saldırısı, üretilen örnekleri ve gerçek dünyadaki örnekleri birbirinden ayırmaya çalışan ve birbirine zıt şekilde çalışan iki parçalı suni zekâ sistemleri olan generative adversarial networks’ü (GAN) kullanır. Bu sistemde generator devamlı yeni data üretirken discriminator ise generator tarafınca üretilen datanın gerçekliğini denetim eder.

Birleşik öğrenme:

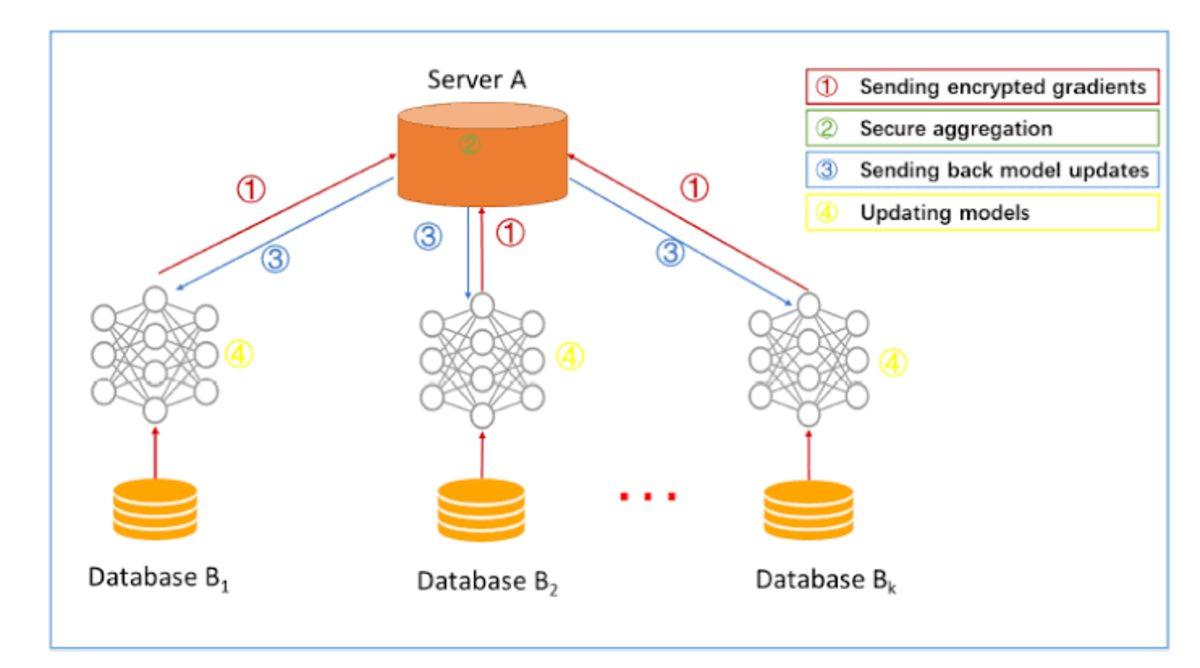

Kolay bir halde tanımlamak gerekirse birleşik öğrenme, suni zekâ algoritmasını merkezi olmayan aygıtlar yada bu örnekleri değiştirmeden veri örnekleri tutan sunucular (şu demek oluyor ki düğümler) üstünden eğiterek, birden fazla tarafın verileri serbestçe paylaşmadan ortak bir makine öğrenme modeli oluşturmasını elde eden bir tekniktir. Bu teknik, mahalli veri örneklerinin yaygın bir halde dağıtıldığını varsayan klasik merkezi olmayan yaklaşımların tam zıttıdır.

Merkezi bir sunucu, algoritmanın adımlarını düzenlemek ve bir referans saat olarak hareket etmek için kullanılabilir yada düzenleme P2P (peer-to-peer) şeklinde olabilir ki bu durumda sunucu yok anlama gelir. Buna karşın mahalli modeller, mahalli veri örnekleri üstünde eğitilir ve ağırlıklar küresel bir model oluşturmak için bazı frekanslarda modeller içinde değiştirilir.

Yinelemeli bir süreç olan bu teknikte mahalli modeller, her bir düğümde bir takım potansiyel model güncellemesi üretmek suretiyle düğümlerde eğitilir. Ondan sonra mahalli güncellemeler tek bir genel güncellemede toplanarak işlenir ve genel modele uygulanır.

Birleşik öğrenme, bu alanda öncü olan Google tarafınca üretime yerleştirilmiştir. Google, bu tekniği kişiselleştirme için Gboard’da iOS ve Android cihazlarının on milyonlarcasında kullanıyor.

Doğal ki hiçbir teknik kusursuz değildir ve birleşik öğrenme, öğrenme sürecinde düğümler içinde sık kontakt gerektiriyor. Makine öğrenme modellerinin parametre alışverişinde bulunabilmesi için mühim oranda işlem gücüne ve belleğe gereksinim vardır. Öteki zorluklar içinde eğitim örneklerinin denetlenememesi benzer biçimde değişkenler bulunmaktadır.

Diferansiyel gizlilik:

Hemen hemen yeni sayılabilecek bir siber güvenlik yaklaşım modeli sayılabilecek diferansiyel gizlilik, teknoloji şirketlerinin bireysel kullananların gizliliğini korurken, kullanıcı alışkanlıkları hakkında bilgiler toplayabilmesine de olanak tanır. Şu demek oluyor ki bu modelde ender detayların ezberlenmesi önlenir ve nihai şahıs ile alakalı bilgilerin çıkarılamayacağını güvence edilir.

Teknoloji devi Apple, 2017 yılından beri popüler emojilerini, Safari’deki medya oynatma tercihlerini ve daha fazlasını tanımlamak için bir çeşit diferansiyel gizlilik kullanıyor ve şirket en güncel iOS sürümünde (iOS 13) bunu birleşik öğrenme ile birleştirdi. Her iki teknik de Siri’nin sunmuş olduğu sonuçların yanı sıra Apple’ın QuickType klavyesi ve iOS’un Found In Apps uygulamalarının iyileştirilmesine destek oluyor.

Ne yazık ki diferansiyel gizlilik de muhteşem değil. Bu teknikte temel verilere, girişe, çıkışa yada parametrelere entegre edilen gürültü, genel modelin performansını etkisinde bırakır. Daha ilkin meydana getirilen bir çalışmada araştırmacılar, eğitim veri setine gürültü eklendikten sonrasında tahmin doğruluğunun %94,4’ten %24,7’ye düştüğünü belirttiler.

Homomorfik şifreleme:

Homomorfik şifreleme yeni bir şey değil şundan dolayı ilk şema, IBM araştırmacısı Craig Gentry tarafınca 2009 senesinde geliştirildi. Temel olarak bu teknik, şifreli metinlerde hesaplama yapılmasına olanak elde eden, şifresi çözüldüğü vakit düz metin üstünde yapılmış benzer biçimde işlemlerin sonucuyla eşleşen şifreli bir netice üreten bir şifreleme şeklidir ve dış kaynaklı depolama ve hesaplamanın gizliliğini korumak için kullanılır.

Intel’in IoT grubunun başkan yardımcısı Jonathan Ballon, bu senenin başlarında meydana getirilen bir röportajda “MRI görüntülerimi gönderirsem, doktorumun onları derhal görebilmesini sadece başka asla kimsenin görmemesini isterim” demişti. “Homomorfik şifreleme, modelin kendisinin de şifrelenmesini sağlar. Bu yüzden bir şirket, bu modeli genel bir buluta koyabilir ve bulut sağlayıcısının modellerin neye benzediğine dair hiçbir fikri yoktur.”

Pratikte, homomorfik şifreleme emekleri hemen hemen çağdaş donanımı tam olarak kullanamamaktadır ve en azından geleneksel modellerden daha yavaş bir büyüklük düzenindedir. Sadece hızlandırılmış bir şifreleme kütüphanesi olan cuHE benzer biçimde daha yeni projeler, önceki uygulamalara gore çeşitli şifreleme görevlerini 12 ila 50 kat içinde hızlandırabiliyor. Bu aşamada Feysbuk’un PyTorch makine öğrenme yapısı ve TensorFlow üstüne kurulmuş olan PySyft ve tf-encrypted benzer biçimde kütüphaneler son aylarda büyük adımlar attı.

Birkaç ay ilkin Intel araştırmacıları HE-Transformer’ın halefi olan nGraph-HE2’yi, mahalli etkinleştirme işlevlerini kullanarak standart, evvel eğitilmiş makine öğrenme modellerinde çıkarım yapılmasını sağlamak için önerdiler.

Gösterilen bir makalede, iş hacminde skaler kodlama (sayısal bir değerin bir bit dizisine kodlanması) açısından emek harcama süresinin 3 kat ile 88 kat daha süratli olduğu ve ek çarpma ve ekleme optimizasyonlarının da 2,6 kat ile 4,2 kat süratli bulunduğunu bildirildi.

Daha gidilecek oldukça yol var:

Yeni teknikler, suni zekâ ve makine öğreniminin doğasında bulunan bazı gizlilik sorunlarını çözebilir sadece daha yolun oldukça başındalar ve birçok eksiklikleri bulunuyor.

Birleşik öğrenme, öğrenme sürecinde düğümler içinde sık kontakt gerektiriyor ve eğitim örneklerinin denetlenmensi oldukça güç. Öte taraftan diferansiyel gizlilikteyse temel verilere, girişe, çıkışa yada parametrelere entegre edilen gürültü, genel modelin performansını etkiliyor ve doğrulukta düşüşlere niçin oluyor. Homomorfik şifrelemeye ulaşınca, birazcık yavaş ve sayısal olarak oldukça emek istiyor.

Gene de gelecekte suni zekâ teknolojisinde ne benzer biçimde gelişmeler yaşanacağını ve gizlilik sorunlarının iyi mi çözüleceğini merak ediyoruz. Iyi mi gelişmeler olacağını ise sadece yaşayıp hep beraber görebileceğiz.

![Türkiye'de 170.000 TL'ye Satılan RTX 5090, Çalışırken Alev Aldı [Video] 11 Türkiye'de 170.000 TL'ye Satılan RTX 5090, Çalışırken Alev Aldı [Video]](https://kitapbar.com/wp-content/uploads/2026/02/648642-700x400-390x220.jpg)