Deepfake Videolar, Artık Daha Kolay Tespit Edilebilecek

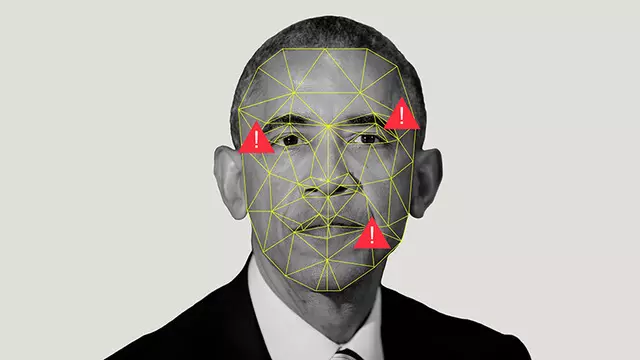

Bilim adamları, kişileri asla yapmadığı yada söylemediği şeyleri yapmış yada söylemiş şeklinde gösteren deepfake videoların tespit edilmesini elde eden teknolojileri geliştirmeye devam ediyorlar.

Deepfake videoların oldukça gerçekçi oldukları için düzgüsel insanoğlu tarafınca fark edilmesi zor. İntikam için kişisel bir tabanca olarak, para piyasalarını manipüle etmek için ya da internasyonal ilişkileri bozmak adına kullanılabilen deepfake videolar, “Görmek inanmaktır” anlayışını tamamen ortadan kaldırabilir.

Bir çok deepfake video, bilgisayar algoritmalarına bir kişinin resimleri verilerek ve bilgisayarın bu resimleri kullanarak yeni yüz resimlerini oluşturmasıyla yapılıyor. Bu süreçte, suni bir ses de benzer bir yöntemle oluşturuluyor. Böylelikle videolar, o kişiyi asla yapmadığı bir şeyi yapmış şeklinde gösteriyor.

Bazı araştırmalar, eski nesil deepfake videoları kişinin göz kırpma sayısıyla ayırt edebiliyordu sadece yeni nesil deepfake videolar o denli gelişmiş ki bu teknoloji onlarda artık işe yaramıyor.

Şimdiyse araştırmacılar, bir videonun manipüle edilip edilmediğini idrak etmek için videonun bazı karelerindeki piksellere bakıyorlar. Ek olarak araştırmacılar, insanları deepfake videolardan korumanın yollarını da araştırıyorlar.

Videodaki hataları saptamak:

Kısa sürede gösterilen 2 araştırmada deepfake videoların orijinal videolardan bazı hatalar ile ayırt edilebileceği belirtiliyor. Ek olarak araştırmalar, bu hataların deepfake videoların yapımcıları tarafınca kolayca düzeltilebilecek hatalar olmadığının da altını çiziyor.

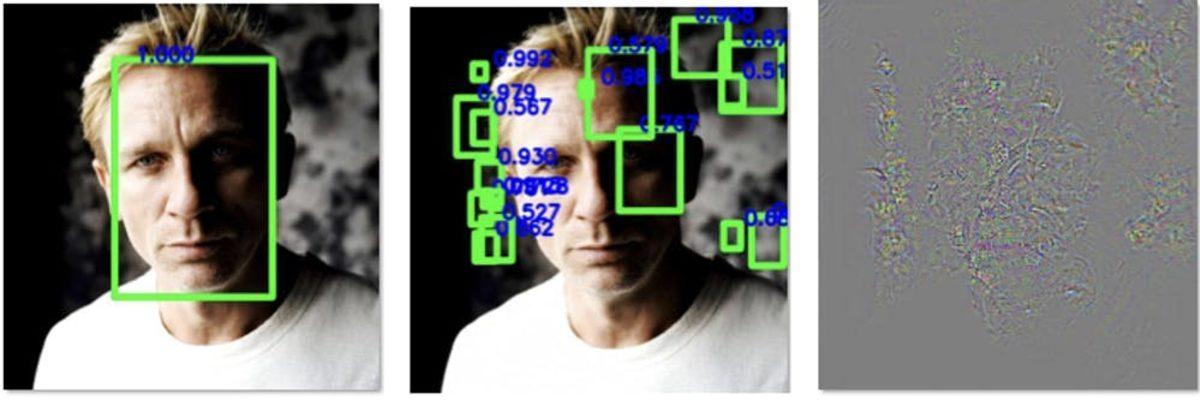

Deepfake video üretme algoritması, yeni bir yüz ifadesi ürettiğinde üretilen yeni fotoğraf daima kişinin konumlamasıyla, ışıklandırma koşullarıyla ya da kamera ile mesafeyle daima %100 uyumlu olmuyor. Oluşturulan resimlerin etrafındakilerle uyumlu hâle gelmesi için geometrik olarak değiştirilmeleri, döndürülmeleri, tekrardan boyutlandırılmaları, kısacası şekillerinin değiştirilmesi gerekiyor. Bu süreç ise resimde dijital kalıntılar bırakıyor.

Bazı kalıntılar gözle de görülebiliyor. Dijital kalıntılardan bazıları resimlerin açıkça değiştirilmiş görünmesine, yüzün kenarlarının bulanık olmasına ve insanların yüzünün kimi zaman gerçek dışı pürüzsüzlükte görünmesine niçin oluyor sadece daha profesyonelce yapılmış değişimler dahi resimde bir kalıntı bırakıyor.

Bu kalıntılar, eğer şahıs kameraya direkt olarak bakmıyorsa değişebiliyor. Bir insanoğlunun yüzünü direkt olarak çeken videolar, o kişinin yüzünün üç boyutlu hareketini gösteriyor sadece şu anki deepfake algoritmaları, hâlâ 3 boyutlu fotoğraf üretemiyor. Bu eksiliği gidermek için algoritmalar, en önce iki boyutlu resimler oluşturuyor ve onların şeklini kişinin nereye baktığına nazaran değiştiriyor sadece bunu o denli da iyi yapmıyorlar. Bu hatalardan yararlanan araştırmacılar da deepfake videoları tespit edilebiliyorlar.

Bir araştırma grubu, bir kişinin burnunun resimlerde nereye bakması icap ettiğini hesaplayan bir algoritma geliştirdi. Bu algoritma, ek olarak o kişinin kafasının ne yönde olması icap ettiğini, yüzünün kontörlerini kullanarak hesaplayabiliyor. Bir kişinin gerçek videosunda tüm bu hesaplamalar birbirleriyle uyumlu oluyor sadece deepfake videolarda bu hesaplamalar çoğu zaman birbirleriyle çelişiyor.

Deepfake videolara karşı korunma teknikleri:

Deepfake ve onları tespit etmeyi elde eden teknolojiler adeta bir tabanca yarışını çağrıştırıyor. Düzmece videoyu meydana getiren kişiler, deepfake videoları devamlı geliştirmek zorunda. Bundan dolayı onların tespit edilmesini elde eden teknolojiler de devamlı gelişim hâlinde olmalı. Bir grup araştırmacı, deepfake algoritmalarının ürettikleri resimlerde hata bulmasını elde eden bir yöntem geliştirdi.

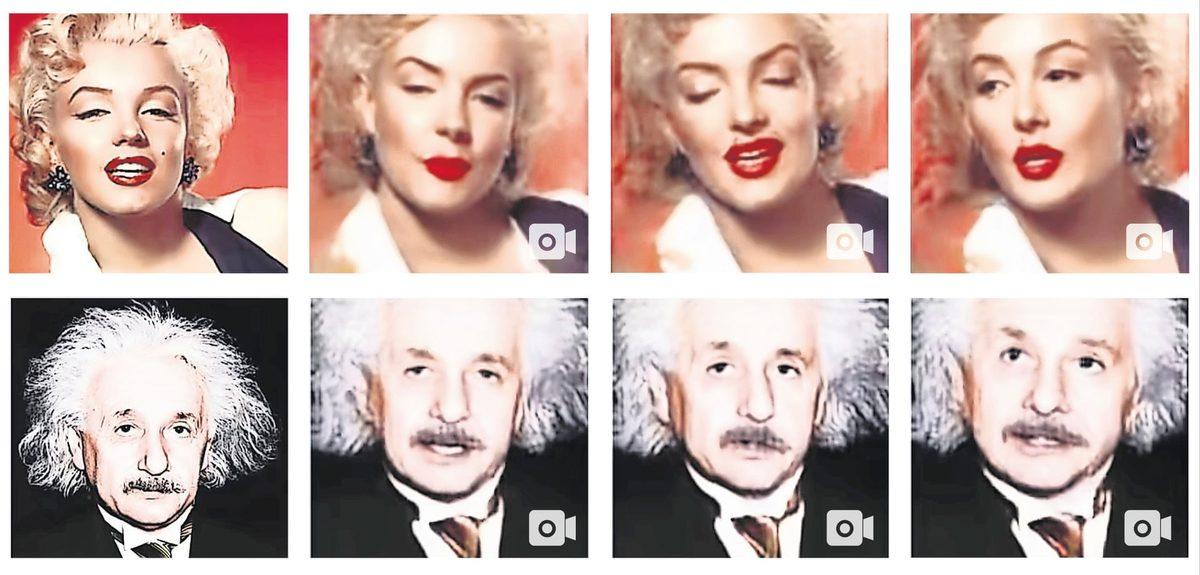

Yüz resimleri kütüphaneleri, binlerce resmi ve videoyu işleyen ek olarak yüzleri saptayan, onları seçen bir makine öğrenimi tekniğini kullanan algoritmalar tarafınca oluşturuluyor. Bu algoritmalar, bir sınıfın resmine bakarak oradaki tüm yüzleri algılayabiliyor ve bir tek yüz resimlerini kütüphaneye ekleyebiliyor. Netice olarak ortaya çıkan yüz kütüphanesinde birçok kaliteli yüz resmi var ise bu kütüphane kullanılarak oluşturulan deepfake algoritmaları daha başaralı oluyor.

Bazı araştırmacı, bu dijital fotoğraf yada videolara hususi olarak tasarlanmış kusurlar eklemeyi başardı. Bu kusurları yüz saptama algoritmaları, çoğu zaman es geçiyor ve kusurlu resimleri de kütüphanelere ekliyor. Bu fotoğraflarda, yüz bulucuları kandıran px desenleri var. Kısacası yüz bulucular, bu resimlere baktıkları vakit aslına yüz olmayan yerlerde de yüz varmış sanıyor.

Daha azca gerçek yüz ve algoritmaların eğitim verisini kirleten hatalı resimlerle deepfake oluşturma algoritmaları, yüz resimleri oluştururken daha hatalı resimler üretiyor. Bu, hem deepfake üretim sürecini yavaşlatıyor hem de oluşturulan düzmece videoların daha kolay bir halde tespit edilmesini sağlıyor.

Araştırmacılar, bu algoritmayı geliştirdikçe onu insanların toplumsal medyaya yada başka bölgelere yükledikleri resimlere de uygulamayı amaçlıyorlar. Bunu yapmak için araştırmacılar resimleri internete yüklerken şu uyarı kullanılabileceklerini söylüyor: “Bu fotoğraf yada videodaki yüzlerin deepfake videolarda kullanılmasına karşı korunmasını ister misiniz?” Şahıs evet seçeneğini seçerse bu algoritmanın resimlere gözle fark edilemeyen kusurlar ekleyebileceği vurgulanıyor.