Suni Zekânın Kullanıldığı Korkulu Pedofili Ağı: ClothOff

Suni zekânın ilerleme hızı ve yapabileceklerinin sınırsızlığı her geçen gün bizi hayrete düşürüp heyecanlandırıyor. Sadece bu sınırsızlık, pedofili şeklinde korkulu olgulara da hizmet edebiliyor. Şimdi size suni zekâ tabanlı “ClothOff” pedofili ağını anlatacağız.

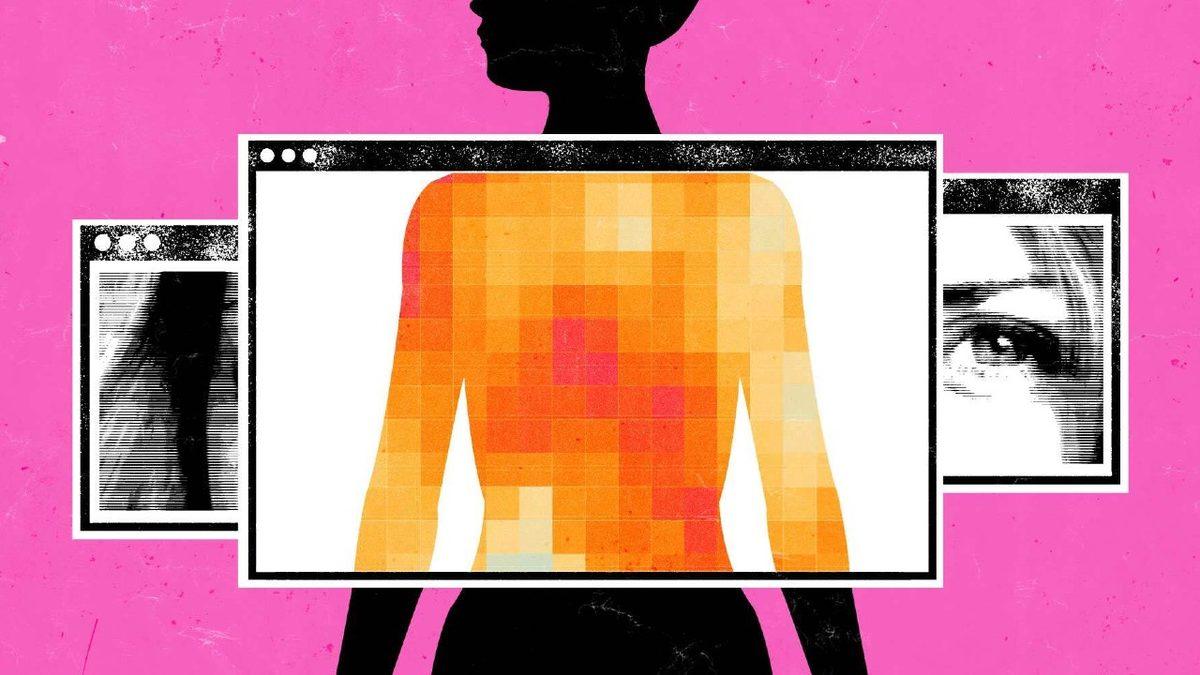

Suni zekâ yöntemiyle istediğiniz kişinin çıplak fotoğrafını önünüze sunabilen “ClothOff” adlı uygulama, reşit olmayan birçok kız çocuğunun şantaja ve ruhsal şiddete maruz kalmasına sebep oldu. Kızların gerçek olmayan fakat gerçeğinden farkı olmayan çıplak görüntüleri elden ele yayıldı.

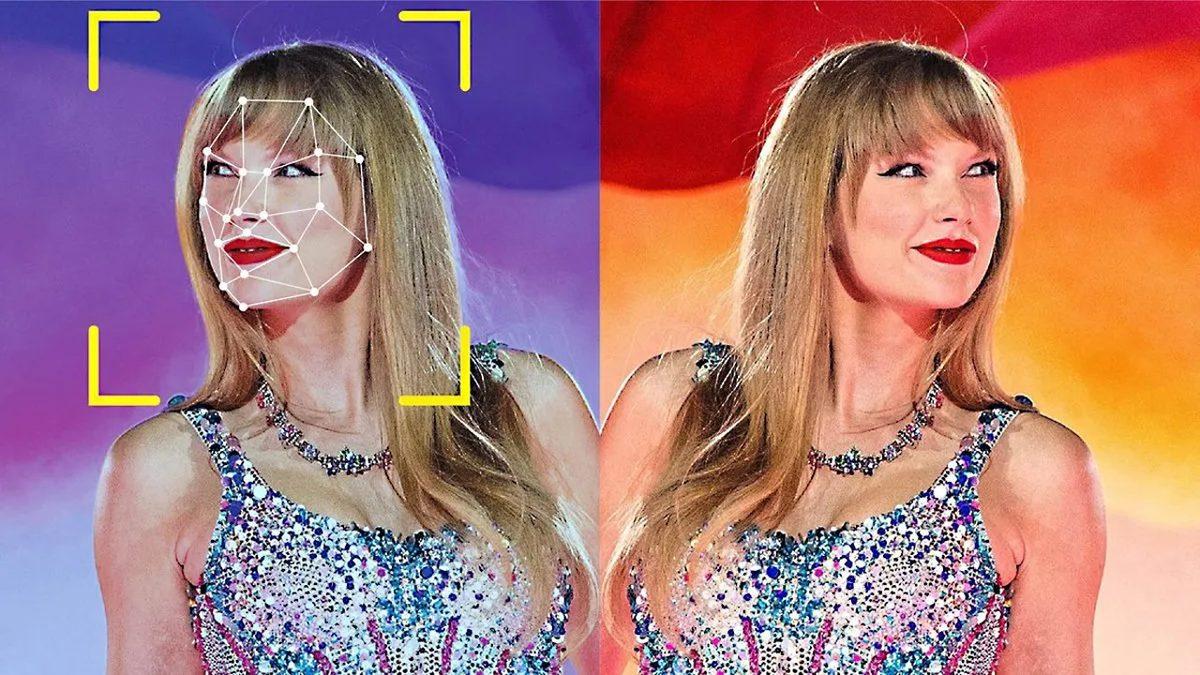

The Guardian’ın öncülüğünde araştırılmaya devam eden mevzunun detaylarına inmeden ilkin “deepfake” dediğimiz şey tam olarak nedir ve ne şeklinde şeyler yapabilir bir bakalım.

Deepfake nedir?

Deepfake, çoğunlukla suni zekâ teknikleriyle oluşturulan düzmece ya da manipüle edilmiş ses kayıtları, videolar ya da fotoğraflardır. Mesela birinin videosu oldukca gerçekçi bir halde değiştirilerek videoda söylediğinden oldukca değişik şeyler söylüyormuş şeklinde yapılabilir.

Aynı şekilde sizin bir fotoğrafınız kullanılarak yapmadığınız bir eylemde bulunuyormuş ya da bir şey söylüyormuş şeklinde gösterilebilirsiniz. Tamamı, birkaç fotoğrafın ya da videonun verileri kullanılarak kusursuz bir halde gerçekleştirilebilir.

Şuraya bir deepfake videosu da bırakalım:

Tek kurban Taylor Swift de değil.

Hatırlarsanız geçtiğimiz ay Taylor Swift’in deepfake görüntüleri epey gündem olmuştu. Ne yazık ki bu durum yalnızca birkaç kişinin başına gelmiyor. Bilmediğimiz şehirlerde, kasabalarda, topluluklarda; birçok insanoğlunun bu şekilde görüntüleri kullanılabiliyor.

Şu demek oluyor ki Taylor Swift buz dağının bir tek görünen kısmıydı. Bizim içeriğimize mevzu olan dehşet verici dosya da İspanya’nın ufak Almendralejo nahiyesinde geçiyor.

“ClothOff” adlı uygulama, korkulu bir pedofili ağı başlattı.

The Guardian’ın 1 Mart 2024 tarihinde yayımladığı habere nazaran kasabadaki kız öğrencilerin suni zekâ tarafınca oluşturulan düzinelerce çıplak fotoğrafları, okuldaki öteki çocuklar tarafınca kurulan bir WhatsApp grubunda dolaşıma girmişti.

Deepfake fotoğraflar yüzünden ciddi anksiyete yaşayan ve depresyona giren kızlar, okula gitmeyi bile bırakmıştı. Ürkü ataklar geçiriyor, şantaja ve zorbalığa maruz kalıyorlardı.

Kızlardan birinin anası şu sözleri söylemişti: “Gördüğünüzde şoke oluyorsunuz. Görüntü tamamen gerçek şeklinde… Kızımın vücudunu tanımasaydım kesinlikle o görüntünün gerçek bulunduğunu düşünürdüm.”

Aynı durum ABD New Jersey’de de yaşanıyordu.

Almendralejo’dan binlerce kilometre uzaklıktaki New Jersey’deki bir lisede de aynı vakalar vardı. Liseli kızlar, sınıflarındaki öteki öğrenciler tarafınca oluşturulan deepfake görüntülerin kurbanı olmuştu. İspanya ve New Jersey’deki olayların merkezinde ise “ClothOff” adlı aynı uygulama vardı.

Ayda 4 milyondan fazla ziyaret edilen ClothOff’a girmek için 18 yaşın üstünde olduğunuzu onayladıktan sonrasında 25 görsel için 8.50 euro ücret ödemeniz yeterliydi. Bir kişinin fotoğrafını yüklediğinizde size çıplak versiyonunu veriyordu.

Korkulu pedofili ağının arkasındakiler hâlâ araştırılmaya devam ediyor.

ClothOff’un ardındaki kişiler anonim olmayı iyi bir halde sürdürebiliyordu sadece The Guardian’ın yapmış olduğu 6 aylık bir araştırma, birkaç kişinin adını ortaya çıkardı. İpuçları, Belarus’ta bir adam ve kız kardeşe götürmüştü. Şirket, paravan şirket üstünden gelir elde ederek kara para aklıyordu.

Erişilen kişilerden biri ClothOff’un kurucusu bulunduğunu kabul etti fakat 18 yaşlarının altında kişilerin görüntülerinin kullanılamayacağını söylemiş oldu. Avrupa’da kayıtlı işletmeler ve Londra’daki yerleşik paravan firmalar üstünden çalışan karmaşık bir ağ var.

Uygulamaya erişim birçok ülkeden engellendi fakat dünyanın her yerinden çeşitli yöntemlerle hâlâ kullanılabiliyor. Görüntülerin iyi mi oluşturulduğu ve arkasında tam olarak kimlerin olduğu hâlâ araştırılmaya devam ediyor.